Guide Labs презентує інноваційний формат інтерпретованого LLM.

Проблема, що виникає під час створення моделі глибокого навчання, часто зводиться до необхідності зрозуміти її внутрішню логіку: будь то численні спроби xAI виправити незвичну політику Grok, чи ж боротьба ChatGPT з підлабузництвом, або звичайні випадки галюцинацій. Розібратися в нейронній мережі, що містить мільярди параметрів, виявляється досить складним завданням.

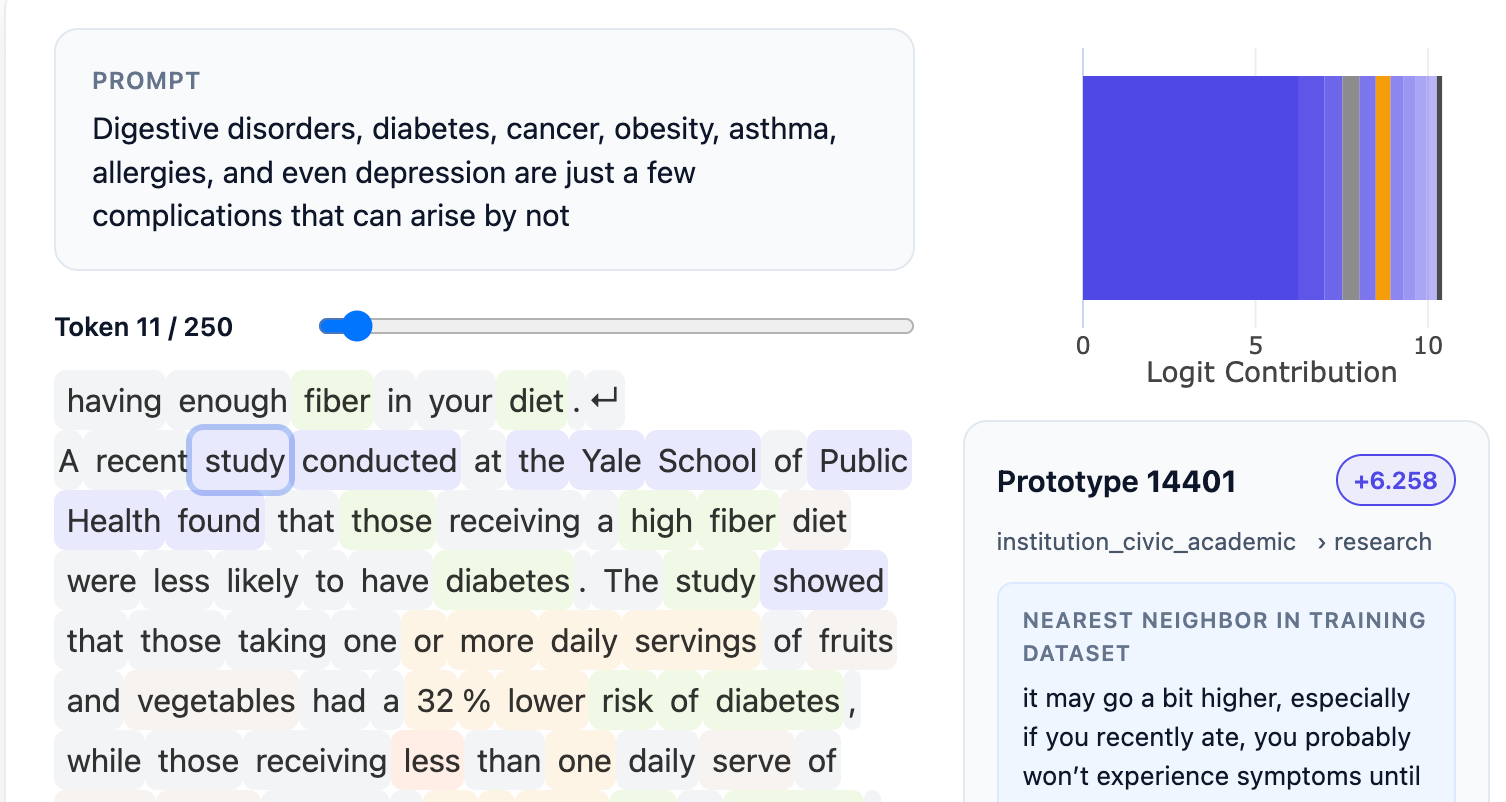

Guide Labs, стартап із Сан-Франциско, який очолює генеральний директор Джуліус Адебайо разом з головним науковим співробітником Аєю Абдельсалам Ісмаїл, сьогодні представляє рішення для цієї проблеми. У понеділок компанія анонсувала свою нову модель з 8 мільярдами параметрів, названа Steerling-8B. Ця модель була навчена за допомогою інноваційної архітектури, яка забезпечує легкість інтерпретації її дій: кожен згенерований токен можна відслідкувати до його початкового джерела в навчальних даних.

Це може бути так просто, як визначення довідкових матеріалів для фактів, на які посилається модель, або так складно, як розуміння моделі гумору чи гендеру.

"Якщо я маю трильйон варіантів кодування гендеру і реалізую їх у 1 мільярді з 1 трильйона доступних елементів, ви повинні впевнитися, що виявили всі ці 1 мільярд закодованих елементів. Далі вам слід мати можливість надійно активувати та деактивувати їх," -- зазначив Адебайо у бесіді з TechCrunch. "Це можливо за допомогою сучасних моделей, проте це вкрай нестабільно... Це своєрідне питання, яке можна порівняти з пошуками Святого Грааля".

Адебайо розпочав цю роботу, здобуваючи ступінь доктора філософії в MIT, ставши співавтором широко цитованої статті 2018 року, яка показала, що існуючі методи розуміння моделей глибокого навчання не є надійними. Ця робота в кінцевому підсумку привела до створення нового способу побудови LLM: розробники вставляють у модель концептуальний шар, який розподіляє дані на відстежувані категорії. Це вимагає більшої попередньої анотації даних, але за допомогою інших моделей штучного інтелекту вони змогли навчити цю модель як найбільший доказ концепції на сьогоднішній день.

"Те, що люди інтерпретують, — це... нейробіологія на основі існуючих моделей, а ми підходимо до цього інакше," - зазначив Адебайо. "Ми фактично створюємо модель з самого початку, щоб вам не доводилося заглиблюватися в нейробіологію."

Одне з головних занепокоєнь стосовно цього підходу полягає в можливості втрати нових форм поведінки, які роблять LLM такими захоплюючими: їхня здатність узагальнювати інформацію на основі нових даних, з якими вони ще не стикалися. Адебайо зазначає, що ця здатність все ще проявляється в моделі його компанії: його команда спостерігає за тим, що вони називають "відкритими концепціями", які модель здатна виявляти самостійно, як, наприклад, у випадку з квантовими обчисленнями.

Адебайо зазначає, що така інтерпретована архітектура стане незамінною для багатьох. Для споживчих LLM ці методи повинні надати можливість розробникам моделей обмежувати використання матеріалів, які підпадають під авторське право, а також краще контролювати результати, пов'язані з такими темами, як насильство або наркотична залежність. Регульовані сфери, зокрема фінансовий сектор, вимагатимуть більш ретельно контрольованих LLM, адже, наприклад, модель, що аналізує кандидатів на кредит, повинна враховувати фінансову історію, але не расову приналежність. Інтерпретованість також є важливою в наукових дослідженнях — ще одній сфері, де Guide Labs впровадила свої технології. Розробка білків стала значним досягненням для моделей глибокого навчання, проте вчені потребують більш глибокого розуміння причин, чому їхні алгоритми обрали певні перспективні комбінації.

"Ця модель демонструє, що навчання інтерпретованих моделей більше не є наукою; тепер це інженерна проблема", -- сказав Адебайо. "Ми розібралися в науці і можемо масштабувати їх, і немає жодних причин, чому така модель не могла б відповідати продуктивності моделей найвищого рівня", які мають набагато більше параметрів.

Guide Labs заявляє, що їхня модель Steerling-8B здатна досягти 90% ефективності на рівні існуючих рішень, проте для навчання вона використовує значно менше даних завдяки інноваційній архітектурі. Наступним етапом для компанії, яка виникла в рамках Y Combinator і в листопаді 2024 року отримала 9 мільйонів доларів початкового фінансування від Initialized Capital, стане розробка більш потужної моделі та впровадження API та агентського доступу для користувачів.

"Спосіб, яким ми зараз навчаємо моделі, є надзвичайно примітивним, тому демократизація вродженої інтерпретованості насправді буде довгостроковою користю для нашої ролі в людстві", -- сказав Адебайо TechCrunch. "Оскільки ми прагнемо створити надзвичайно інтелектуальні моделі, ви не хочете, щоб щось, що є для вас загадкою, приймало рішення від вашого імені".